NanoAI - 企业级 AI 商业化中台

(注:请在 public/images 放一张脱敏后的架构图,如果暂无,可先注释掉此行)

(注:请在 public/images 放一张脱敏后的架构图,如果暂无,可先注释掉此行)

1. 项目背景 (Context)

客户为国内某知名 疗愈与知识付费平台。该平台拥有庞大的线下代理商网络和复杂的会员权益体系。 痛点: 客户希望引入 AI 对话功能(类似 GPT)赋能学员,但市面上的通用 AI 无法识别其特有的行业术语,且无法接入其原有的 会员等级与分销返佣 系统。

2. 核心挑战 (Challenge)

- 商业逻辑复杂: 需要打通原有的 CRM 系统,实现“不同等级会员每日差异化 Token 额度”及“代理商推广返佣”。

- 多租户架构: 系统不仅要服务主品牌,未来还需具备 OEM 能力,快速为其他机构贴牌部署。

- 高并发流式体验: 在数百人并发请求下,必须保证打字机效果(SSE)的极低延迟。

3. 解决方案 (Solution)

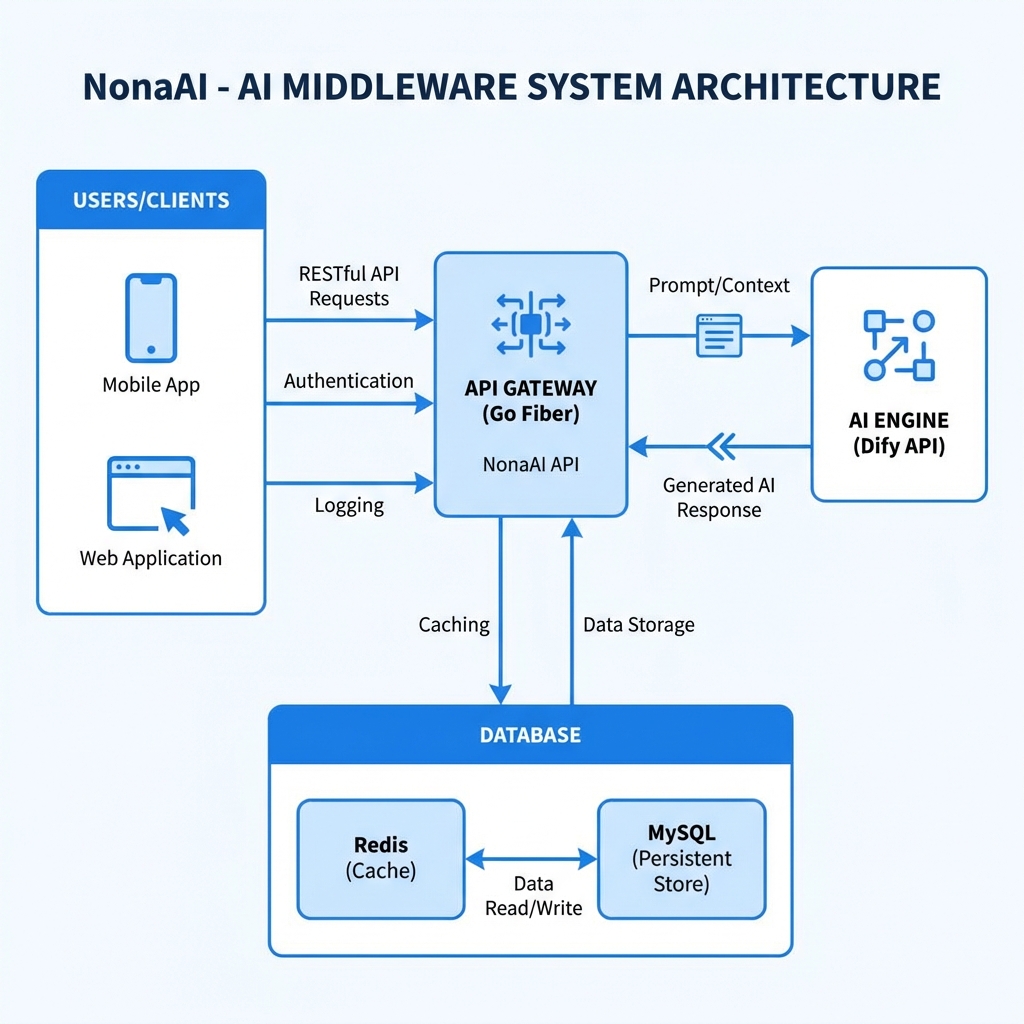

作为首席架构师,我采用了 "Go + Vue3 前后端分离" 的轻量化架构:

🏗 技术架构

- 后端 (Go Fiber): 利用 Go 的高并发特性处理 API 请求。设计了统一的网关层,负责鉴权、流式转发与 Token 计费。

- AI 编排 (Dify): 底层模型接入 Dify API。通过 Prompt 优化,让 AI 能够理解“身心商业”领域的专有逻辑。

- 数据层 (MySQL + Redis): Redis 负责实时的 Token 扣除与限流,MySQL 存储分销关系与对话历史。

💰 商业功能实现

- 权益映射系统: 开发了一套中间件,将客户原有的

VIP_Level自动映射为 NanoAI 的Token_Limit。 - 分销裂变: 用户分享海报 -> 扫码注册 -> 自动绑定上下级 -> AI 消费返佣。实现了完整的商业闭环。

4. 项目成果 (Result)

- 🚀 性能表现: 在单核 2G 的轻量级服务器上,稳定支撑了业务高峰期的并发请求,响应延迟 < 200ms。

- 💼 商业价值: 成功协助客户将 AI 工具作为“高客单价课程”的增值权益,直接提升了 20% 的课程复购率。

- 🔧 极低运维: 采用 Docker Swarm 部署,实现了服务的高可用与快速回滚。